Pourquoi les intelligences artificielles inventent-elles des réponses ?

Vous avez peut-être déjà entendu le terme « hallucination » appliqué à l’intelligence artificielle. Un modèle qui cite un article de loi qui n’existe pas. Un assistant qui calcule une indemnité de licenciement à 107 000 € alors que le montant réel est de 2 625 €. Une référence jurisprudentielle inventée de toutes pièces, rédigée avec la même assurance qu’une vraie décision de la Cour de cassation.

Ce n’est pas un bug que les développeurs ont oublié de corriger. C’est une conséquence directe de la façon dont ces systèmes fonctionnent — et la comprendre, c’est déjà savoir comment s’en protéger.

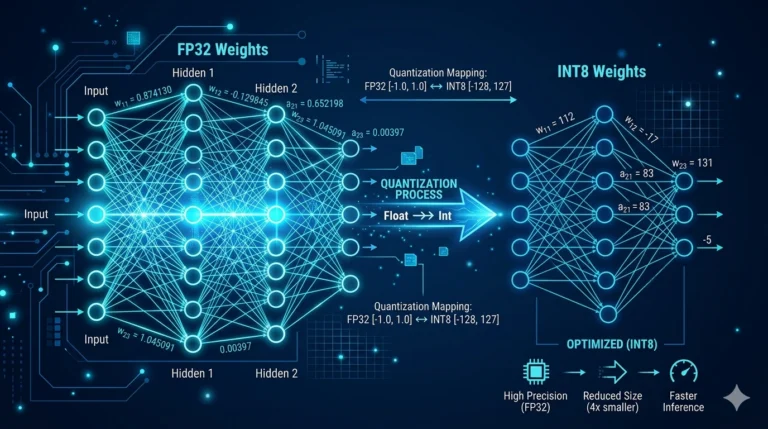

Un modèle de langage ne « sait » pas. Il prédit.

Un grand modèle de langage — qu’il s’appelle GPT, Claude, Gemma ou Llama — n’a pas été conçu pour stocker des faits comme une base de données. Il a été entraîné sur des milliards de textes pour apprendre une seule chose : quelle suite de mots est la plus probable après une autre suite de mots.

Quand vous lui posez une question, il ne cherche pas la réponse dans un fichier. Il génère une réponse qui ressemble à ce qu’un texte humain bien formé dirait en réponse à cette question. La plupart du temps, cette réponse est juste — parce que les textes sur lesquels il a été entraîné contenaient beaucoup de réponses justes. Mais parfois, il génère quelque chose de plausible qui n’est pas vrai.

C’est précisément ce qu’on appelle une hallucination : une réponse fluide, bien construite, confiante — et fausse.

Pourquoi ça arrive : trois mécanismes concrets

1. Le modèle comble les lacunes

Quand une information manque dans ce que le modèle « voit » au moment de répondre, il ne dit pas « je ne sais pas ». Il continue à générer du texte plausible. C’est sa nature profonde.

Exemple concret : lors de nos tests, nous avons demandé à un modèle de calculer l’indemnité légale de licenciement d’un salarié avec 5 ans d’ancienneté et un salaire de 2 100 € brut. La formule correcte — un quart de mois par année d’ancienneté — figurait bien dans l’index documentaire, mais dans un article réglementaire séparé que le système n’avait pas récupéré. Le modèle, ne voyant pas la formule, en a inventé une : il a multiplié le salaire par le coefficient hiérarchique du salarié (185), divisé par 173,6, et annoncé un résultat de 94 650 €. Le calcul était cohérent en apparence. Il était entièrement faux.

2. Le modèle confond des concepts proches

Les modèles ont été entraînés sur des textes qui mentionnent souvent les mêmes termes ensemble. Quand une question active plusieurs concepts proches, le modèle peut les mélanger.

Exemple concret : interrogé sur la procédure de licenciement pour faute grave, un modèle a cité les articles L.1235-1 et L.1235-2 — qui concernent en réalité le licenciement sans cause réelle et sérieuse, c’est-à-dire la sanction d’un licenciement abusif devant les prud’hommes. Ces articles parlent bien de licenciement, bien d’indemnités, bien de procédure — mais pas du tout de ce qui était demandé. Le modèle a associé les bons mots-clés aux mauvais articles.

3. Le modèle invente des sources pour justifier ses affirmations

C’est la forme la plus trompeuse d’hallucination. Le modèle génère non seulement une affirmation fausse, mais aussi une référence qui semble la valider — un numéro d’article, un arrêt de jurisprudence, une décision administrative — qui n’existe tout simplement pas.

Exemple concret : lors d’un test sur la validité d’une clause de non-concurrence, un modèle a cité la « décision n°2014-1400 QBL » de la Cour de cassation pour justifier qu’une contrepartie financière de 30 % serait insuffisante. Cette décision n’existe pas. Le numéro, le format, la référence — tout était inventé, mais tout ressemblait à une vraie décision de jurisprudence.

Pourquoi c’est particulièrement dangereux dans les professions réglementées

Dans un usage général — rédiger un email, résumer un article, brainstormer des idées — une hallucination est souvent détectable et rarement grave. On relit, on vérifie, on corrige.

Dans le droit, la médecine, la comptabilité ou l’assurance, c’est différent. Une indemnité mal calculée peut conduire à un litige. Un article de loi inventé peut fonder une décision erronée. Une clause contrat rédigée sur une base jurisprudentielle fictive peut être contestée devant un tribunal.

Le professionnel qui utilise un outil d’IA sans en comprendre les limites prend un risque réel — non seulement pour son client, mais pour sa propre responsabilité.

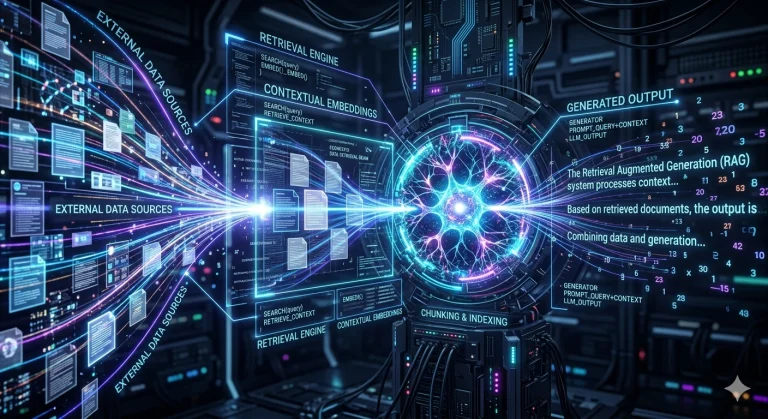

Ce que le RAG change — et ce qu’il ne change pas

Un système RAG — comme celui qu’utilise ArkeoAI — réduit considérablement le risque d’hallucination en forçant le modèle à répondre à partir de documents réels, indexés et vérifiables. Le modèle ne répond plus depuis sa mémoire générale : il répond depuis ce qu’on lui montre.

Mais le RAG n’est pas une protection absolue. Comme nous l’avons vu dans l’article précédent, si les documents sont mal découpés et que des informations liées se retrouvent dans des blocs séparés, le modèle peut quand même combler les lacunes — et halluciner.

C’est pourquoi la qualité d’un système RAG ne se mesure pas seulement au modèle utilisé, mais à la façon dont la base documentaire a été construite, organisée et maintenue. Un modèle moyen avec une base documentaire bien structurée donnera de meilleurs résultats qu’un modèle puissant avec une base mal indexée.

La bonne posture face à l’IA : confiance et vigilance

L’objectif n’est pas de faire peur à l’IA, ni de la rejeter. Ces outils sont réellement utiles — pour retrouver rapidement une information dans un dossier volumineux, pour reformuler un document, pour identifier les clauses pertinentes dans un contrat, pour gagner du temps sur des tâches répétitives.

La bonne posture, c’est celle du professionnel qui utilise une calculatrice : il fait confiance au résultat pour les opérations courantes, mais il sait reconnaître quand un chiffre ne semble pas raisonnable — et il vérifie.

Avec l’IA, c’est pareil. La réponse peut être juste. Elle peut aussi être très bien rédigée et complètement fausse. La différence entre les deux, c’est votre regard professionnel — et un système conçu pour rendre ce regard possible.

C’est précisément ce qu’ArkeoAI vous donne : un outil puissant, sur vos propres données, dans votre environnement, avec la transparence nécessaire pour que vous restiez maître de la décision.