Qu’est-ce qu’une fenêtre de contexte ?

Le secret de la « mémoire à court terme » de l’IA

La première fois que l’on entend parler de la « fenêtre de contexte » d’un modèle d’intelligence artificielle, on acquiesce généralement et on passe à autre chose. Puis, quelques semaines plus tard, lorsque le système IA se comporte étrangement, il oublie quelque chose mentionné cinq minutes plus tôt, ou confond le début d’un document avec sa fin et la question devient soudainement très pertinente : qu’est-ce que c’est exactement, et pourquoi est-ce important ?

En termes simples : la fenêtre de contexte désigne la quantité de texte qu’une IA peut « voir » et traiter à un instant donné. Pas plus, pas moins. C’est la mémoire de travail active du modèle, l’espace qui contient tout ce qu’il peut prendre en compte à un moment précis.

La bibliothécaire qui ne voit qu’une table de travail

Imaginez la scène suivante. Vous entrez dans une bibliothèque où vous accueille une bibliothécaire exceptionnellement savante et expérimentée. Cette personne a accumulé un vaste savoir au fil des décennies : elle connaît les textes de loi, la littérature spécialisée, la jurisprudence. À chaque question que vous lui posez, elle répond immédiatement et avec précision.

Il y a cependant une règle particulière : elle ne peut considérer à la fois que ce qui tient sur une seule table de travail. Cette table peut contenir, disons, vingt-cinq pages de texte. Si l’information nécessaire à votre question tient sur cette table : le document, les questions précédentes, les éléments de contexte et comme cela, elle travaille parfaitement. Mais si vous essayez d’y poser un contrat de trois cents pages, soit le début tombe, soit la fin, et la bibliothécaire ne voit que ce qui reste.

Cette table, c’est la fenêtre de contexte.

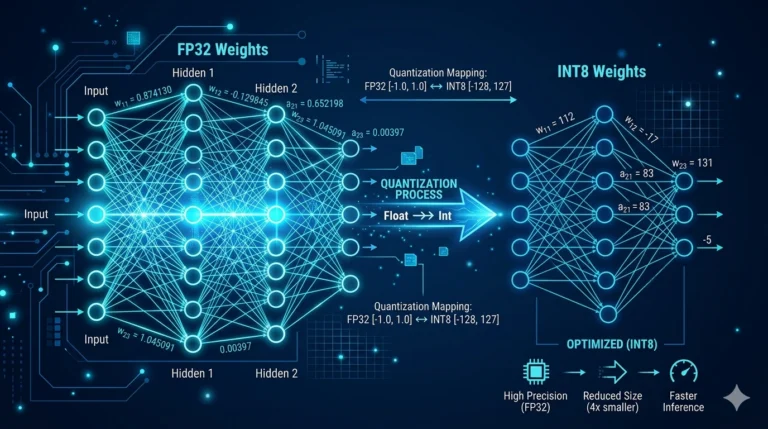

Tokens et tailles : le monde des chiffres

La taille d’une fenêtre de contexte se mesure généralement en tokens. Un token n’équivaut pas à un mot : il correspond à environ quatre caractères, ce qui signifie qu’un mot moyen représente un à deux tokens. Mille tokens correspondent à environ huit cents mots, soit à peu près la longueur d’un article de journal dense.

Les différents modèles travaillent avec des fenêtres de contexte de tailles différentes :

• Petits modèles locaux : 4 000-8 000 tokens (environ 3 000 à 6 000 mots)

• Modèles intermédiaires : 32 000-128 000 tokens

• Grands modèles cloud : plus de 200 000 tokens

Au premier abord, ces chiffres peuvent paraître abstraits. Pour les rendre concrets : un contrat juridique standard comporte généralement entre cinq et quinze mille mots. Un dossier comptable annuel complet – avec bilans, factures et correspondance – peut facilement dépasser cent mille mots.

Que se passe-t-il quand quelque chose « tombe » hors de la fenêtre ?

C’est à ce stade que de nombreux utilisateurs rencontrent un phénomène apparemment inexplicable. Le système IA ne se « souvient » plus soudainement d’un élément mentionné peu auparavant. Ou il se contredit lui-même. Ou il analyse la fin d’un document alors que le début ne tient plus dans sa mémoire active.

Il est important de comprendre : ce n’est ni une erreur, ni un manque d’attention. C’est une limite physique du modèle. Ce qu’il ne voit pas sur la table, il ne peut tout simplement pas en tenir compte – non pas parce qu’il ne le veut pas, mais parce que cette information n’est plus présente pour lui.

Les différents modèles gèrent cette situation de manières différentes. Certains abandonnent le début de la fenêtre (les parties les plus anciennes dans le temps), d’autres compriment le milieu. Dans tous les cas, le résultat est qu’une partie de l’information se perd.

Pourquoi la taille de la fenêtre est-elle importante ?

La taille de la fenêtre de contexte détermine directement les types de tâches auxquelles un modèle est adapté.

Avantage d’une grande fenêtre : des documents longs peuvent être analysés en une seule fois ; des tâches complexes à plusieurs étapes peuvent être accomplies sans que l’IA n’« oublie » ce qui a été dit au début.

Inconvénient d’une grande fenêtre : le traitement est plus lent, nécessite plus de capacité de calcul, et pour les modèles fonctionnant localement en mode hors ligne, cela représente une charge matérielle significative.

Avantage d’une petite fenêtre : plus rapide, plus efficace, moins de ressources matérielles nécessaires, idéale pour un déploiement local.

Inconvénient d’une petite fenêtre : avec des documents plus longs, le contexte peut se perdre ; le modèle ne voit qu’un fragment de l’ensemble.

Dans la réalité, la grande majorité des tâches professionnelles quotidiennes ne nécessite pas une fenêtre de contexte gigantesque. C’est là qu’il convient de réfléchir de manière réaliste.

Dans le cas d’ArkeoAI : pourquoi ce n’est pas un problème ?

Le système ArkeoAI n’a pas été conçu pour l’analyse de longs documents. Son mode d’utilisation principal n’est pas de télécharger un dossier de deux cents pages et d’attendre que le modèle le lise, l’interprète et le résume en une seule étape.

La force d’ArkeoAI réside dans des réponses précises et ciblées.

Le système fonctionne de la manière suivante : les documents propres à votre cabinet (p.ex. modèles, dossiers antérieurs, règlements internes, données clients) sont pré-traités et stockés de manière structurée. Lorsque vous posez une question, le modèle ne « lit pas » l’intégralité de la base de données ; il extrait uniquement les passages pertinents et y répond. C’est l’essence même de la technologie RAG (Génération augmentée par récupération).

La conséquence est que ce qui entre dans la fenêtre de contexte n’est pas un document de trois cents pages, mais la question et les quelques paragraphes véritablement pertinents. Cela tient facilement. Le modèle voit tout ce qu’il doit voir : ni plus, ni moins.

ArkeoAI fonctionne donc de manière fiable non pas parce qu’il dispose d’une immense fenêtre de contexte, mais parce qu’il filtre intelligemment ce qui y entre. C’est la différence entre la puissance de calcul brute et la conception intelligente.

Qu’est-ce que cela signifie en pratique ?

Un juriste qui cherche une réponse sur une clause contractuelle spécifique ne souhaite probablement pas une analyse de deux heures. Un comptable qui demande une confirmation sur la classification comptable d’une facture précise n’attend pas un traité scientifique. Un assistant médical qui recherche une donnée spécifique dans le dossier d’un patient veut précisément cette donnée-là.

ArkeoAI est précisément adapté à ces tâches. La réponse est exacte, rapide, et fondée sur les données de votre cabinet et non sur des données étrangères stockées dans le cloud, ni sur des informations sensibles transmises par internet.

La taille de la fenêtre de contexte est un paramètre technique. Dans le cas d’ArkeoAI, ce paramètre est géré de manière adéquate et vous n’avez pas à vous en préoccuper.