La bibliothécaire qui ne perd jamais rien : comprendre comment une IA lit vos documents

Vous avez peut-être déjà essayé de « donner un document » à ChatGPT : vous joignez un contrat, vous posez une question, l’IA répond. C’est pratique. Mais vous avez sûrement remarqué qu’à la session suivante, elle a tout oublié. Vous recommencez. Vous rejoignez le fichier. Vous reposez la question.

Il existe une autre façon de procéder : plus efficace, plus sécurisée, et infiniment plus adaptée à l’usage professionnel. Elle s’appelle le RAG. Et pour comprendre comment ça fonctionne, imaginez une bibliothécaire très particulière.

La bibliothécaire qui connaît tous vos dossiers

Imaginez que vous engagez une bibliothécaire pour gérer toute la documentation de votre cabinet. Le premier jour, vous lui donnez l’accès à tous vos dossiers : contrats, procédures, modèles, jurisprudences, notes internes. Elle passe la semaine à tout lire, à tout classer, à créer des fiches de synthèse. Elle ne mémorise pas chaque mot, mais elle sait exactement où chercher.

À partir du deuxième lundi, vous pouvez lui poser n’importe quelle question : « Dans le contrat Dupont de 2022, quelle est la clause de résiliation ? » Elle ne relit pas tout le contrat. Elle consulte sa fiche, va directement au bon endroit, et vous donne la réponse en quelques secondes.

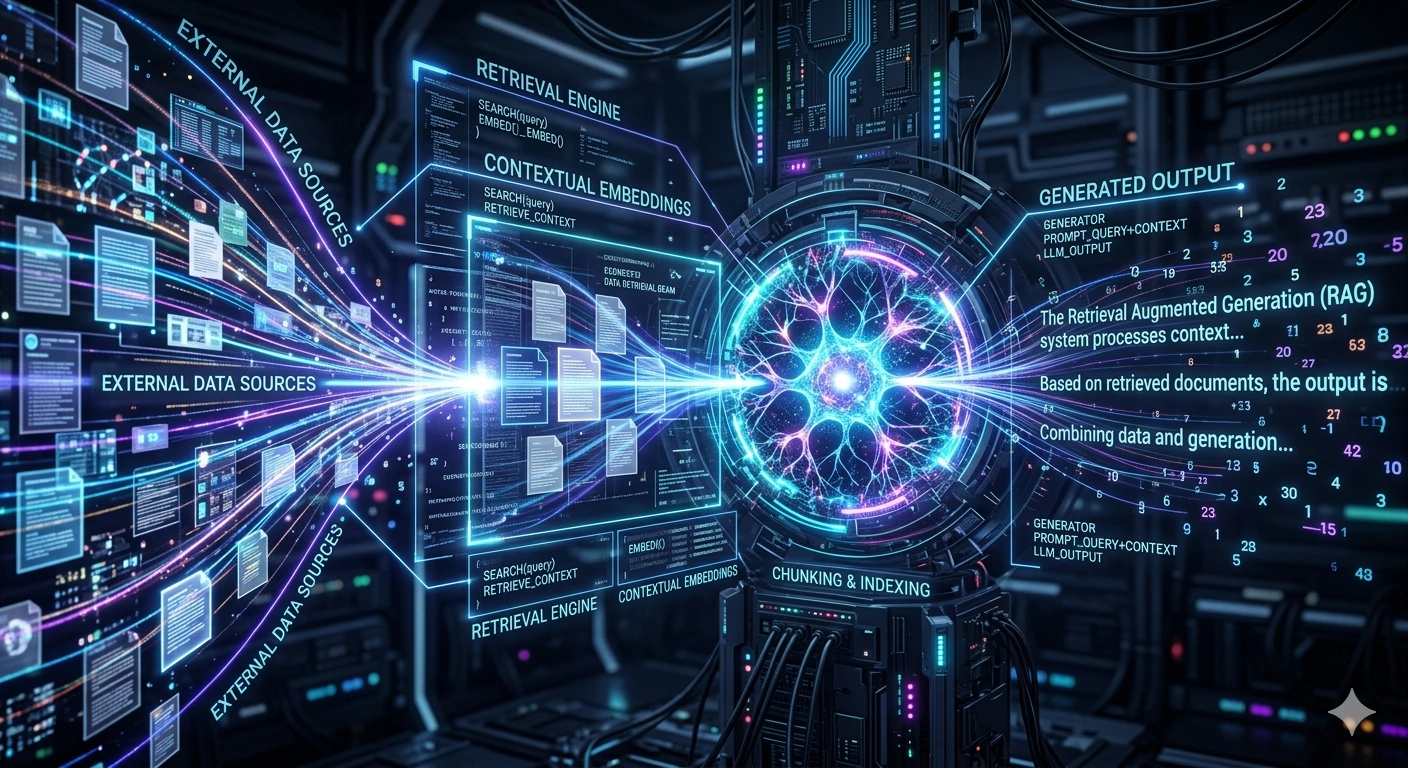

C’est exactement ce que fait un système RAG. RAG signifie Retrieval-Augmented Generation — littéralement : génération augmentée par la recherche.

Vous n’avez pas besoin de lui redonner le contrat à chaque fois. Il est déjà dans sa mémoire de travail. Et si vous mettez à jour un document, il suffit de le lui signaler et elle met à jour sa fiche, et c’est tout.

Concrètement, que se passe-t-il quand on « indexe » des documents ?

L’indexation, c’est le travail de catalogage de notre bibliothécaire. Techniquement, voici ce qui se passe, étape par étape :

| 1 : Lecture des documents | L’IA parcourt chaque fichier (PDF, Word, texte…) et le découpe en petits blocs de quelques paragraphes. |

| 2 : Création d’empreintes | Chaque bloc est converti en une suite de chiffres (ce qu’on appelle un « vecteur ») qui représente son sens : pas ses mots exacts, mais son contenu sémantique. |

| 3 : Stockage dans un index | Ces empreintes sont rangées dans une base de données locale, comme un catalogue de bibliothèque très précis. |

| 4 : Réponse à une question | Quand vous posez une question, l’IA cherche dans l’index les blocs les plus proches de votre question et les utilise pour construire sa réponse. |

Ce processus se déroule une seule fois lors de l’installation. Ensuite, chaque question prend moins d’une seconde.

Où sont stockés ces index ? Qui peut les voir ?

C’est là que la différence entre une solution cloud et une solution locale devient cruciale.

Dans une solution cloud (ChatGPT Enterprise, Microsoft Copilot, etc.) : vos documents sont envoyés vers des serveurs distants pour être indexés. L’index est stocké chez le fournisseur. Techniquement, ce fournisseur a accès à vos données, même s’il s’engage contractuellement à ne pas les utiliser. Et en cas de violation de données chez lui, c’est votre cabinet qui est exposé.

Dans ArkeoAI : l’indexation se fait directement sur le mini PC installé dans vos locaux. Les index ne quittent jamais votre réseau. Personne d’autre que vous n’y a accès, nous non plus.

Vos documents n’ont jamais à quitter votre cabinet pour être « compris » par l’IA. L’intelligence vient à eux, pas l’inverse.

Qui crée l’index, et combien ça coûte ?

Dans le cadre d’ArkeoAI, c’est nous qui réalisons l’indexation initiale lors de l’installation. Vous nous fournissez vos documents (ou l’accès à votre dossier partagé) et nous paramétrons le système pour qu’il sache où chercher et comment répondre.

Ce travail est inclus dans l’installation. Il n’y a pas de coût par document indexé, ni de facturation à l’usage. Une fois le système en place, il tourne en autonomie.

Et si vous ajoutez de nouveaux documents ? Vous nous contactez ou, selon votre configuration, vous pouvez le faire vous-même via une interface simple. L’IA met à jour son index en quelques minutes, sans interruption de service.

Pourquoi ne pas simplement joindre le document à chaque question ?

C’est la solution la plus intuitive – et la plus limitée. Voici pourquoi :

- La mémoire de l’IA est limitée. Un modèle IA ne peut traiter qu’une certaine quantité de texte à la fois (ce qu’on appelle la « fenêtre de contexte »). Un contrat de 80 pages dépasse souvent cette limite et l’IA coupe, sans vous le dire clairement.

- Vous devez tout redonner à chaque session. Aucune mémoire ne persiste entre deux conversations. Chaque fois, vous recomposez le contexte manuellement.

- Les données partent à chaque envoi. Chaque fichier joint à une question est transmis au serveur du fournisseur. Pour des documents confidentiels, c’est une exposition répétée.

- Ça ne fonctionne pas sur plusieurs documents simultanément. Si votre réponse nécessite de croiser trois contrats et deux notes internes, la méthode « joindre » devient vite ingérable.

| Joindre un document | RAG (ArkeoAI) | |

| Se souvient d’une session à l’autre | ✗ Non | ✓ Oui |

| Indexation de centaines de docs | ✗ Non | ✓ Oui |

| Retrouve l’information pertinente | Partiel | ✓ Automatique |

| Données envoyées à l’extérieur | ✗ À chaque envoi | ✓ Jamais |

| Mise à jour des documents | ✗ Manuel à chaque fois | ✓ Une mise à jour suffit |

| Fonctionne sans internet | ✗ Non | ✓ Oui |

Pourquoi ChatGPT Enterprise nécessite-t-il un abonnement séparé ?

ChatGPT Enterprise inclut une fonctionnalité similaire au RAG — appelée « Knowledge » ou base de connaissances personnalisée. Mais cette fonctionnalité nécessite une infrastructure supplémentaire de la part d’OpenAI : des serveurs dédiés pour stocker vos index, une isolation de vos données par rapport aux autres clients, une équipe technique pour la configuration.

C’est pourquoi ce niveau de service ne peut pas être inclus dans l’abonnement standard à 20 €. Il nécessite un contrat d’entreprise avec engagement annuel, configuration par un interlocuteur dédié, et un tarif qui démarre autour de 60 €/utilisateur/mois.

En résumé : vous payez plus cher parce que vous demandez plus, mais vous payez toujours pour que quelqu’un d’autre gère vos données à votre place.

Avec ArkeoAI, vous ne sous-traitez pas la gestion de vos données. Vous en restez propriétaire et gestionnaire avec toute la tranquillité d’esprit que cela implique.

Ce qu’il faut retenir

Joindre un document à une question, c’est pratique pour un usage ponctuel. Mais pour un cabinet professionnel qui travaille quotidiennement avec ses propres fichiers, c’est une solution de fortune.

Le RAG, c’est la version professionnelle de ce processus : l’IA connaît vos documents en permanence, sans que vous ayez à les lui redonner, sans qu’ils quittent vos locaux, et sans coût supplémentaire à chaque question.

C’est la différence entre emprunter un livre à chaque fois que vous en avez besoin et avoir votre propre bibliothécaire qui connaît chaque page de votre fonds documentaire.